From Wikipedia, the free encyclopedia

The standard error (SE)[1] of a statistic (usually an estimate of a parameter) is the standard deviation of its sampling distribution[2] or an estimate of that standard deviation. If the statistic is the sample mean, it is called the standard error of the mean (SEM).[1]

The sampling distribution of a mean is generated by repeated sampling from the same population and recording of the sample means obtained. This forms a distribution of different means, and this distribution has its own mean and variance. Mathematically, the variance of the sampling mean distribution obtained is equal to the variance of the population divided by the sample size. This is because as the sample size increases, sample means cluster more closely around the population mean.

Therefore, the relationship between the standard error of the mean and the standard deviation is such that, for a given sample size, the standard error of the mean equals the standard deviation divided by the square root of the sample size.[1] In other words, the standard error of the mean is a measure of the dispersion of sample means around the population mean.

In regression analysis, the term «standard error» refers either to the square root of the reduced chi-squared statistic or the standard error for a particular regression coefficient (as used in, say, confidence intervals).

Standard error of the sample mean[edit]

Exact value[edit]

Suppose a statistically independent sample of

Practically this tells us that when trying to estimate the value of a population mean, due to the factor

Estimate[edit]

The standard deviation

As this is only an estimator for the true «standard error», it is common to see other notations here such as:

A common source of confusion occurs when failing to distinguish clearly between:

Accuracy of the estimator[edit]

When the sample size is small, using the standard deviation of the sample instead of the true standard deviation of the population will tend to systematically underestimate the population standard deviation, and therefore also the standard error. With n = 2, the underestimate is about 25%, but for n = 6, the underestimate is only 5%. Gurland and Tripathi (1971) provide a correction and equation for this effect.[3] Sokal and Rohlf (1981) give an equation of the correction factor for small samples of n < 20.[4] See unbiased estimation of standard deviation for further discussion.

Derivation[edit]

The standard error on the mean may be derived from the variance of a sum of independent random variables,[5] given the definition of variance and some simple properties thereof. If

which due to the Bienaymé formula, will have variance

where we’ve approximated the standard deviations, i.e., the uncertainties, of the measurements themselves with the best value for the standard deviation of the population. The mean of these measurements

The variance of the mean is then

The standard error is, by definition, the standard deviation of

For correlated random variables the sample variance needs to be computed according to the Markov chain central limit theorem.

Independent and identically distributed random variables with random sample size[edit]

There are cases when a sample is taken without knowing, in advance, how many observations will be acceptable according to some criterion. In such cases, the sample size

[6]

which follows from the law of total variance.

If

(since the standard deviation is the square root of the variance).

Student approximation when σ value is unknown[edit]

In many practical applications, the true value of σ is unknown. As a result, we need to use a distribution that takes into account that spread of possible σ’s.

When the true underlying distribution is known to be Gaussian, although with unknown σ, then the resulting estimated distribution follows the Student t-distribution. The standard error is the standard deviation of the Student t-distribution. T-distributions are slightly different from Gaussian, and vary depending on the size of the sample. Small samples are somewhat more likely to underestimate the population standard deviation and have a mean that differs from the true population mean, and the Student t-distribution accounts for the probability of these events with somewhat heavier tails compared to a Gaussian. To estimate the standard error of a Student t-distribution it is sufficient to use the sample standard deviation «s» instead of σ, and we could use this value to calculate confidence intervals.

Note: The Student’s probability distribution is approximated well by the Gaussian distribution when the sample size is over 100. For such samples one can use the latter distribution, which is much simpler.

Assumptions and usage[edit]

An example of how

In particular, the standard error of a sample statistic (such as sample mean) is the actual or estimated standard deviation of the sample mean in the process by which it was generated. In other words, it is the actual or estimated standard deviation of the sampling distribution of the sample statistic. The notation for standard error can be any one of SE, SEM (for standard error of measurement or mean), or SE.

Standard errors provide simple measures of uncertainty in a value and are often used because:

- in many cases, if the standard error of several individual quantities is known then the standard error of some function of the quantities can be easily calculated;

- when the probability distribution of the value is known, it can be used to calculate an exact confidence interval;

- when the probability distribution is unknown, Chebyshev’s or the Vysochanskiï–Petunin inequalities can be used to calculate a conservative confidence interval; and

- as the sample size tends to infinity the central limit theorem guarantees that the sampling distribution of the mean is asymptotically normal.

Standard error of mean versus standard deviation[edit]

In scientific and technical literature, experimental data are often summarized either using the mean and standard deviation of the sample data or the mean with the standard error. This often leads to confusion about their interchangeability. However, the mean and standard deviation are descriptive statistics, whereas the standard error of the mean is descriptive of the random sampling process. The standard deviation of the sample data is a description of the variation in measurements, while the standard error of the mean is a probabilistic statement about how the sample size will provide a better bound on estimates of the population mean, in light of the central limit theorem.[7]

Put simply, the standard error of the sample mean is an estimate of how far the sample mean is likely to be from the population mean, whereas the standard deviation of the sample is the degree to which individuals within the sample differ from the sample mean.[8] If the population standard deviation is finite, the standard error of the mean of the sample will tend to zero with increasing sample size, because the estimate of the population mean will improve, while the standard deviation of the sample will tend to approximate the population standard deviation as the sample size increases.

Extensions[edit]

Finite population correction (FPC)[edit]

The formula given above for the standard error assumes that the population is infinite. Nonetheless, it is often used for finite populations when people are interested in measuring the process that created the existing finite population (this is called an analytic study). Though the above formula is not exactly correct when the population is finite, the difference between the finite- and infinite-population versions will be small when sampling fraction is small (e.g. a small proportion of a finite population is studied). In this case people often do not correct for the finite population, essentially treating it as an «approximately infinite» population.

If one is interested in measuring an existing finite population that will not change over time, then it is necessary to adjust for the population size (called an enumerative study). When the sampling fraction (often termed f) is large (approximately at 5% or more) in an enumerative study, the estimate of the standard error must be corrected by multiplying by a »finite population correction» (a.k.a.: FPC):[9]

[10]

which, for large N:

to account for the added precision gained by sampling close to a larger percentage of the population. The effect of the FPC is that the error becomes zero when the sample size n is equal to the population size N.

This happens in survey methodology when sampling without replacement. If sampling with replacement, then FPC does not come into play.

Correction for correlation in the sample[edit]

If values of the measured quantity A are not statistically independent but have been obtained from known locations in parameter space x, an unbiased estimate of the true standard error of the mean (actually a correction on the standard deviation part) may be obtained by multiplying the calculated standard error of the sample by the factor f:

where the sample bias coefficient ρ is the widely used Prais–Winsten estimate of the autocorrelation-coefficient (a quantity between −1 and +1) for all sample point pairs. This approximate formula is for moderate to large sample sizes; the reference gives the exact formulas for any sample size, and can be applied to heavily autocorrelated time series like Wall Street stock quotes. Moreover, this formula works for positive and negative ρ alike.[11] See also unbiased estimation of standard deviation for more discussion.

See also[edit]

- Illustration of the central limit theorem

- Margin of error

- Probable error

- Standard error of the weighted mean

- Sample mean and sample covariance

- Standard error of the median

- Variance

- Variance of the mean and predicted responses

References[edit]

- ^ a b c d Altman, Douglas G; Bland, J Martin (2005-10-15). «Standard deviations and standard errors». BMJ: British Medical Journal. 331 (7521): 903. doi:10.1136/bmj.331.7521.903. ISSN 0959-8138. PMC 1255808. PMID 16223828.

- ^ Everitt, B. S. (2003). The Cambridge Dictionary of Statistics. Cambridge University Press. ISBN 978-0-521-81099-9.

- ^ Gurland, J; Tripathi RC (1971). «A simple approximation for unbiased estimation of the standard deviation». American Statistician. 25 (4): 30–32. doi:10.2307/2682923. JSTOR 2682923.

- ^ Sokal; Rohlf (1981). Biometry: Principles and Practice of Statistics in Biological Research (2nd ed.). p. 53. ISBN 978-0-7167-1254-1.

- ^ Hutchinson, T. P. (1993). Essentials of Statistical Methods, in 41 pages. Adelaide: Rumsby. ISBN 978-0-646-12621-0.

- ^ Cornell, J R; Benjamin, C A (1970). Probability, Statistics, and Decisions for Civil Engineers. NY: McGraw-Hill. pp. 178–179. ISBN 0486796094.

- ^ Barde, M. (2012). «What to use to express the variability of data: Standard deviation or standard error of mean?». Perspect. Clin. Res. 3 (3): 113–116. doi:10.4103/2229-3485.100662. PMC 3487226. PMID 23125963.

- ^ Wassertheil-Smoller, Sylvia (1995). Biostatistics and Epidemiology : A Primer for Health Professionals (Second ed.). New York: Springer. pp. 40–43. ISBN 0-387-94388-9.

- ^ Isserlis, L. (1918). «On the value of a mean as calculated from a sample». Journal of the Royal Statistical Society. 81 (1): 75–81. doi:10.2307/2340569. JSTOR 2340569. (Equation 1)

- ^ Bondy, Warren; Zlot, William (1976). «The Standard Error of the Mean and the Difference Between Means for Finite Populations». The American Statistician. 30 (2): 96–97. doi:10.1080/00031305.1976.10479149. JSTOR 2683803. (Equation 2)

- ^ Bence, James R. (1995). «Analysis of Short Time Series: Correcting for Autocorrelation». Ecology. 76 (2): 628–639. doi:10.2307/1941218. JSTOR 1941218.

Среднее арифметическое, как известно, используется для получения обобщающей характеристики некоторого набора данных. Если данные более-менее однородны и в них нет аномальных наблюдений (выбросов), то среднее хорошо обобщает данные, сведя к минимуму влияние случайных факторов (они взаимопогашаются при сложении).

Когда анализируемые данные представляют собой выборку (которая состоит из случайных значений), то среднее арифметическое часто (но не всегда) выступает в роли приближенной оценки математического ожидания. Почему приближенной? Потому что среднее арифметическое – это величина, которая зависит от набора случайных чисел, и, следовательно, сама является случайной величиной. При повторных экспериментах (даже в одних и тех же условиях) средние будут отличаться друг от друга.

Для того, чтобы на основе статистического анализа данных делать корректные выводы, необходимо оценить возможный разброс полученного результата. Для этого рассчитываются различные показатели вариации. Но то исходные данные. И как мы только что установили, среднее арифметическое также обладает разбросом, который необходимо оценить и учитывать в дальнейшем (в выводах, в выборе метода анализа и т.д.).

Интуитивно понятно, что разброс средней должен быть как-то связан с разбросом исходных данных. Основной характеристикой разброса средней выступает та же дисперсия.

Дисперсия выборочных данных – это средний квадрат отклонения от средней, и рассчитать ее по исходным данным не составляет труда, например, в Excel предусмотрены специальные функции. Однако, как же рассчитать дисперсию средней, если в распоряжении есть только одна выборка и одно среднее арифметическое?

Расчет дисперсии и стандартной ошибки средней арифметической

Чтобы получить дисперсию средней арифметической нет необходимости проводить множество экспериментов, достаточно иметь только одну выборку. Это легко доказать. Для начала вспомним, что средняя арифметическая (простая) рассчитывается по формуле:

где xi – значения переменной,

n – количество значений.

Теперь учтем два свойства дисперсии, согласно которым, 1) — постоянный множитель можно вынести за знак дисперсии, возведя его в квадрат и 2) — дисперсия суммы независимых случайных величин равняется сумме соответствующих дисперсий. Предполагается, что каждое случайное значение xi обладает одинаковым разбросом, поэтому несложно вывести формулу дисперсии средней арифметической:

Используя более привычные обозначения, формулу записывают как:

где σ2 – это дисперсия, случайной величины, причем генеральная.

На практике же, генеральная дисперсия известна далеко не всегда, точнее совсем редко, поэтому в качестве оной используют выборочную дисперсию:

Стандартное отклонение средней арифметической называется стандартной ошибкой средней и рассчитывается, как квадратный корень из дисперсии.

Формула стандартной ошибки средней при использовании генеральной дисперсии

Формула стандартной ошибки средней при использовании выборочной дисперсии

Последняя формула на практике используется чаще всего, т.к. генеральная дисперсия обычно не известна. Чтобы не вводить новые обозначения, стандартную ошибку средней обычно записывают в виде соотношения стандартного отклонения выборки и корня объема выборки.

Назначение и свойство стандартной ошибки средней арифметической

Стандартная ошибка средней много, где используется. И очень полезно понимать ее свойства. Посмотрим еще раз на формулу стандартной ошибки средней:

Числитель – это стандартное отклонение выборки и здесь все понятно. Чем больше разброс данных, тем больше стандартная ошибка средней – прямо пропорциональная зависимость.

Посмотрим на знаменатель. Здесь находится квадратный корень из объема выборки. Соответственно, чем больше объем выборки, тем меньше стандартная ошибка средней. Для наглядности изобразим на одной диаграмме график нормально распределенной переменной со средней равной 10, сигмой – 3, и второй график – распределение средней арифметической этой же переменной, полученной по 16-ти наблюдениям (которое также будет нормальным).

Судя по формуле, разброс стандартной ошибки средней должен быть в 4 раза (корень из 16) меньше, чем разброс исходных данных, что и видно на рисунке выше. Чем больше наблюдений, тем меньше разброс средней.

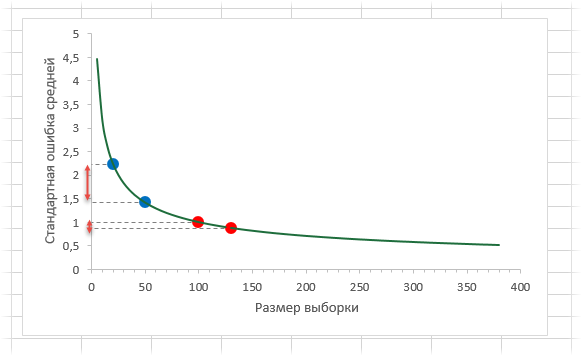

Казалось бы, что для получения наиболее точной средней достаточно использовать максимально большую выборку и тогда стандартная ошибка средней будет стремиться к нулю, а сама средняя, соответственно, к математическому ожиданию. Однако квадратный корень объема выборки в знаменателе говорит о том, что связь между точностью выборочной средней и размером выборки не является линейной. Например, увеличение выборки с 20-ти до 50-ти наблюдений, то есть на 30 значений или в 2,5 раза, уменьшает стандартную ошибку средней только на 36%, а со 100-а до 130-ти наблюдений (на те же 30 значений), снижает разброс данных лишь на 12%.

Лучше всего изобразить эту мысль в виде графика зависимости стандартной ошибки средней от размера выборки. Пусть стандартное отклонение равно 10 (на форму графика это не влияет).

Видно, что примерно после 50-ти значений, уменьшение стандартной ошибки средней резко замедляется, после 100-а – наклон постепенно становится почти нулевым.

Таким образом, при достижении некоторого размера выборки ее дальнейшее увеличение уже почти не сказывается на точности средней. Этот факт имеет далеко идущие последствия. Например, при проведении выборочного обследования населения (опроса) чрезмерное увеличение выборки ведет к неоправданным затратам, т.к. точность почти не меняется. Именно поэтому количество опрошенных редко превышает 1,5 тысячи человек. Точность при таком размере выборки часто является достаточной, а дальнейшее увеличение выборки – нецелесообразным.

Подведем итог. Расчет дисперсии и стандартной ошибки средней имеет довольно простую формулу и обладает полезным свойством, связанным с тем, что относительно хорошая точность средней достигается уже при 100 наблюдениях (в этом случае стандартная ошибка средней становится в 10 раз меньше, чем стандартное отклонение выборки). Больше, конечно, лучше, но бесконечно увеличивать объем выборки не имеет практического смысла. Хотя, все зависит от поставленных задач и цены ошибки. В некоторых опросах участие принимают десятки тысяч людей.

Дисперсия и стандартная ошибка средней имеют большое практическое значение. Они используются в проверке гипотез и расчете доверительных интервалов.

Поделиться в социальных сетях:

Качество

подбора функции регрессии можно оценить

с помощью стандартных ошибок или

дисперсий остатков и оценок параметров

регрессии.

Стандартная

ошибка или дисперсия остатков. Стандартная

ошибка остатков называется также

стандартной ошибкой оценки регрессии

в связи с интерпретацией возмущающей

переменной и как результата ошибки

спецификации функции регрессии.

Возмущающая переменная и является

случайной с определенным распределением

вероятностей. Математическое ожидание

этой переменной равно нулю, а дисперсия

— .

Таким образом,—

это дисперсия возмущения в генеральной

совокупности. Нам неизвестны значения

возмущающей переменной. Можно судить

о ней только по остаткам.

Вычисленная по этим остаткам дисперсияявляется оценкой дисперсии возмущающей

переменной. Несмещенной оценкой дисперсии

возмущающего воздействиябудет, следующее выражение:

(35)

В

знаменателе формулы (35) стоит число

степеней свободы ,

гдеn— объем выборки,

am— число объясняющих переменных.

Такое выражение числа степеней свободы

связано с тем, что остатки должны

удовлетворятьm + 1условиям. Кратко поясним это утверждение.

Параметры множественной регрессии

(36)

вычисляют путем решения системы

нормальных уравнений, в матричной форме

записи имеющих вид

(37)

Подставим

(36) в (37):

Раскрыв

скобки и сделав соответствующие выкладки,

получим

(38)

Матричное

уравнение (38) содержит m

+ 1условий (уравнений), которые

накладываются на остатки, и это приводит

к уменьшению числа степеней свободы.

Приk = 0в силу того, чтох1

= 1для всехi,

(39)

что

является следствием того, что математическое

ожидание возмущающей переменной равно

нулю. Из (38) при k = 1, … , m,

т также получим

(40)

что

вытекает из следующего: переменные xk(k = 1, … , m) не

коррелируют со значениями возмущения,

т. е.xk(k = 1, … , m) являются

действительно объясняющими, а не

подлежащими объяснению переменными.

Следовательно, в регрессионном анализе

могут обсуждаться только односторонне

направленные зависимости. Поскольку

термин «степень свободы» используется

для обозначения независимой информации,

в данном случае число связей, налагаемых

наnнезависимых

случайных наблюдений, можно интерпретировать

какm + 1параметров

(b0, b1

…, bm),

которыми определяется функция регрессии.

В

связи с тем что вычисление числителя в

формуле (35) довольно затруднительно, мы

хотим, опустив вывод, привести более

простой способ его определения:

(41)

или

в матричной форме записи:

Выражения

сумм в правой части (41) содержатся в

рабочей таблице для построения регрессии,

а оценки параметров уже получены. Если

снова обратиться к понятию коэффициента

детерминации, введенному в разделах 1

и 2, то станет ясным физический смысл

дисперсии (или стандартного отклонения)

остатков — это та доля общей дисперсии

,

которая не может быть объяснена

зависимостью переменной у от переменныхxk(k = 1, … , m).

Стандартные

ошибки или дисперсии оценок параметров

регрессии. При описании этих показателей

будем исходить из заданных значений

объясняющих переменных.

Оценки

параметров регрессии являются случайными

величинами, имеющими определенное

распределение вероятностей. Возможные

значения оценок рассеиваются вокруг

истинного значения параметра β. Определим

меру рассеяния оценки параметра.

Обозначим через матрицу дисперсий и ковариаций оценок

параметров регрессии:

Симметрическая

матрица (42) на главной диагонали содержит

дисперсии оценок параметров регрессии

βk,k = 0,1,…,m

(43)

а

вне главной диагонали — их ковариации

(44)

для

k≠lиk = 0,1,…,m, l

= 0,1,…,m.

Краткая

форма записи матрицы (42):

(45)

Подставив

в (45) формулу (46)

(46)

получим

или

(47)

Далее,

в силу того, что

(48)

имеем

(49)

Так

как неизвестно, используем его оценку

.

В результате получаем оценку матрицы

(49),

(50)

элементами

главной диагонали которой являются

искомые оценки дисперсий. Матрицу легко определить, поскольку матрица

известна (см. приложение Б), a

вычисляется по (35).

Если

мы обозначим через элемент главной диагонали матрицы

,

то оценка дисперсии параметра регрессии

bkбудет определяться

выражением

(51)

т.

е. она равна произведению дисперсии

остатков на k-й элемент главной

диагонали обратной матрицы,.

Таким образом, стандартная ошибка оценки

параметра регрессии bkопределяется как

(52)

Найдем

дисперсию и стандартную ошибку оценок

параметров b0и b1простой

линейной регрессии. В случае простой

линейной регрессии имеем

.

а

также

Согласно

формуле (50) получим

Умножая

на первый элемент главной диагонали

матрицы,

получим оценку дисперсии постоянной

уравнения регрессии b0:

(53)

а

также ее стандартную ошибку:

(54)

Умножив

на второй элемент главной диагонали

матрицы,

получим оценку дисперсии коэффициента

регрессии b1

(55)

а

также стандартную ошибку этого

коэффициента:

(56)

Рассмотрим

более обстоятельно стандартную ошибку

коэффициента b1, простой линейной

регрессии. Для этого сумму квадратов

отклонений в (56) заменим на выражение,

полученное путем преобразования формулы

():

Формула

(56) приобретет вид

(57)

Итак,

стандартная ошибка коэффициента

регрессии зависит:

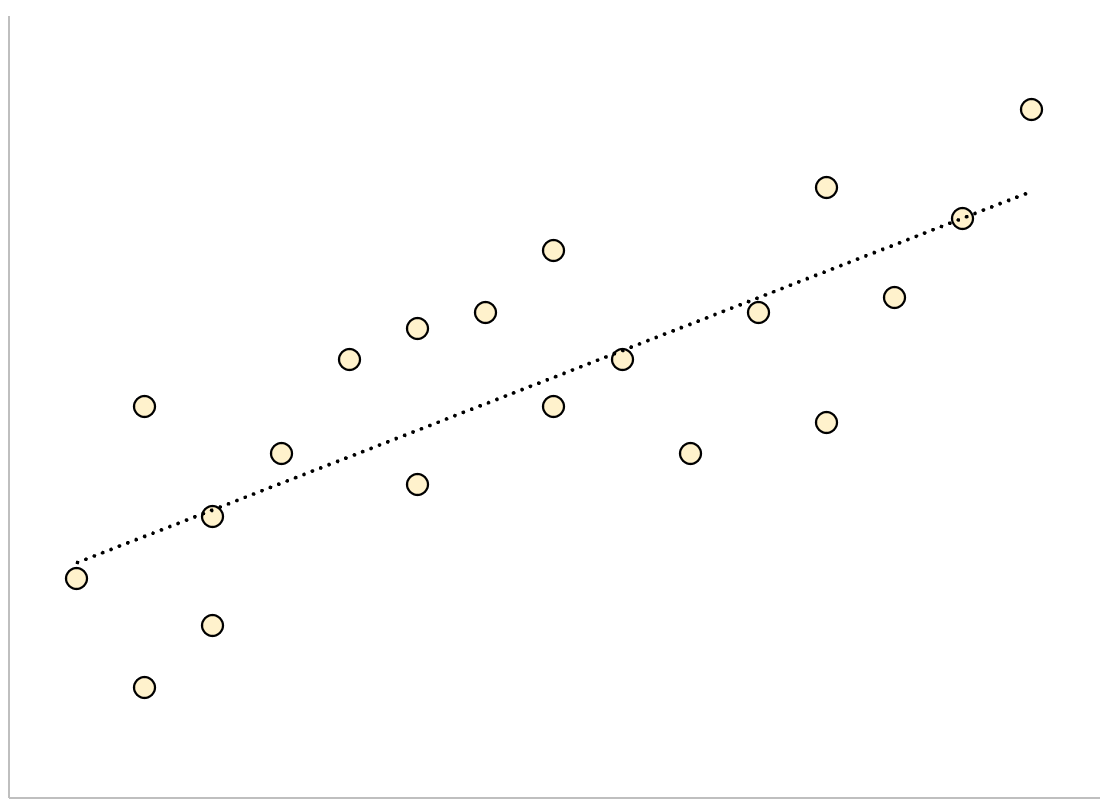

от

рассеяния остатков. Чем больше доля

вариации значений переменной у,

необъясненной ее зависимостью отх,

найденной методом наименьших квадратов,

тем больше стандартная ошибка коэффициента

регрессии. Следовательно, чем сильнее

наблюдаемые значения переменнойуотклоняются от расчетных значений

регрессии, тем менее точной является

полученная оценка параметра регрессии;

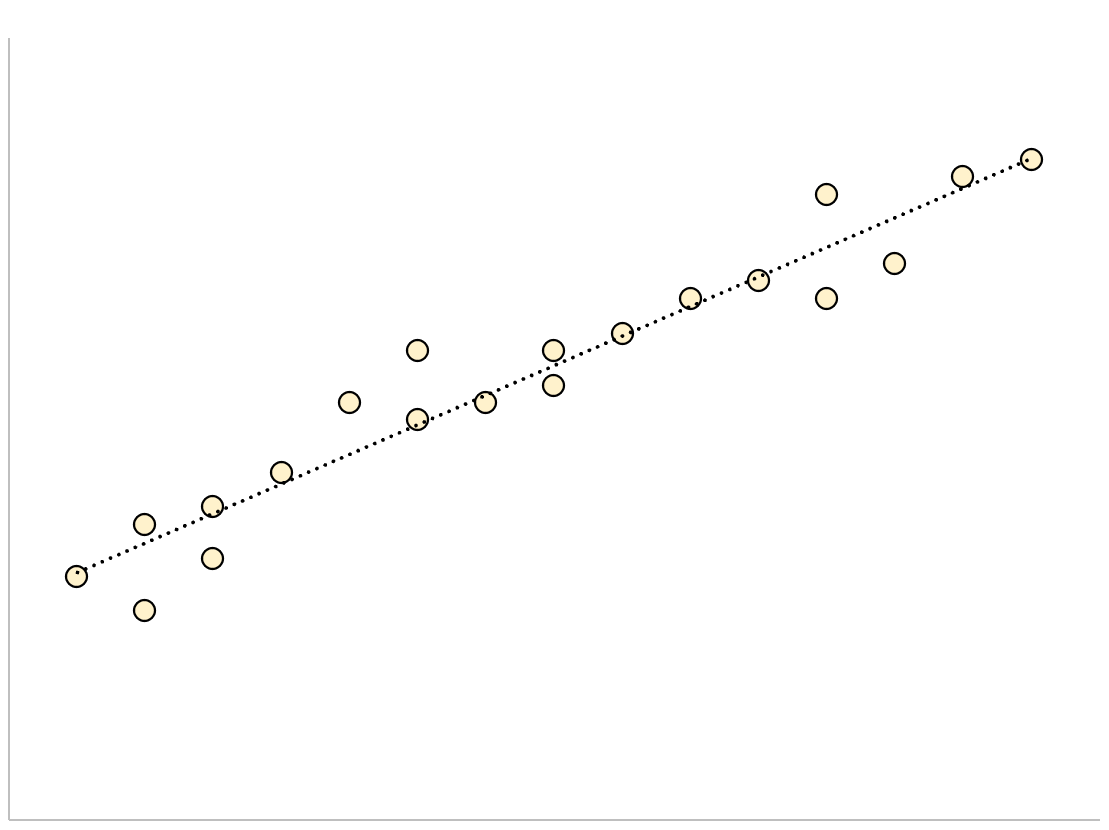

от

рассеяния значений объясняющей переменной

х. Чем сильнее это рассеяние, тем

меньше стандартная ошибка коэффициента

регрессии. Отсюда следует, что при

вытянутом облаке точек на диаграмме

рассеяния получаем более надежную

оценку функции регрессии, чем при

небольшом скоплении точек, близко

расположенных друг к другу;

от

объема выборки. Чем больше объем выборки,

тем меньше стандартная ошибка коэффициента

регрессии. Здесь существует непосредственная

связь с таким свойством оценки параметра

регрессии, как асимптотическая

несмещенность.

Стандартная

ошибка оценки параметра регрессии

используется для оценки качества подбора

функции регрессии. Для этого вычисляется

относительный показатель рассеяния,

обычно выражаемый в процентах:

(58)

Чем

больше относительная стандартная ошибка

оценки параметра, тем более оцененные

величины отличаются от наблюдаемых

значений зависимой переменной и тем

менее надежны оценки прогноза, основанные

на данной функции регрессии.

1

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

Что такое стандартная ошибка оценки? (Определение и пример)

читать 3 мин

Стандартная ошибка оценки — это способ измерения точности прогнозов, сделанных регрессионной моделью.

Часто обозначаемый σ est , он рассчитывается как:

σ est = √ Σ(y – ŷ) 2 /n

куда:

- y: наблюдаемое значение

- ŷ: Прогнозируемое значение

- n: общее количество наблюдений

Стандартная ошибка оценки дает нам представление о том, насколько хорошо регрессионная модель соответствует набору данных. Особенно:

- Чем меньше значение, тем лучше соответствие.

- Чем больше значение, тем хуже соответствие.

Для регрессионной модели с небольшой стандартной ошибкой оценки точки данных будут плотно сгруппированы вокруг предполагаемой линии регрессии:

И наоборот, для регрессионной модели с большой стандартной ошибкой оценки точки данных будут более свободно разбросаны по линии регрессии:

В следующем примере показано, как рассчитать и интерпретировать стандартную ошибку оценки для регрессионной модели в Excel.

Пример: стандартная ошибка оценки в Excel

Используйте следующие шаги, чтобы вычислить стандартную ошибку оценки для регрессионной модели в Excel.

Шаг 1: введите данные

Сначала введите значения для набора данных:

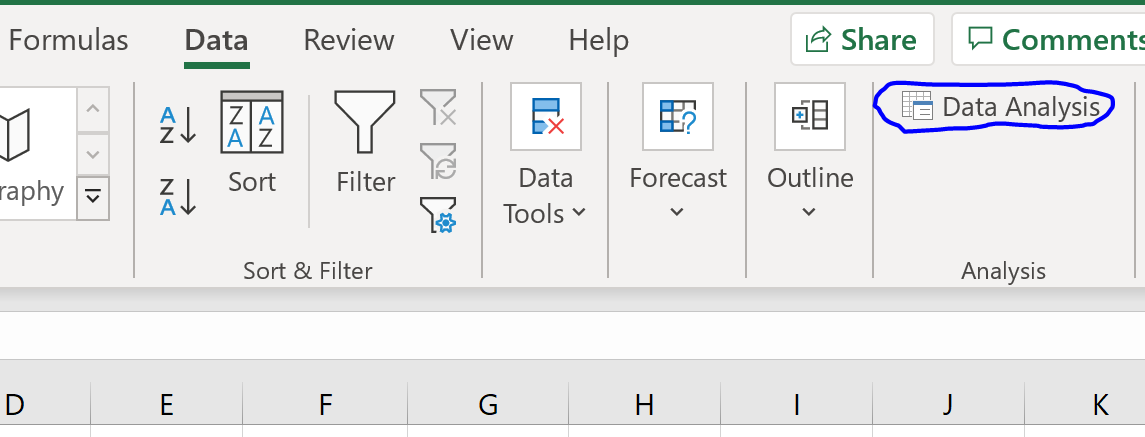

Шаг 2: выполните линейную регрессию

Затем щелкните вкладку « Данные » на верхней ленте. Затем выберите параметр « Анализ данных» в группе « Анализ ».

Если вы не видите эту опцию, вам нужно сначала загрузить пакет инструментов анализа .

В появившемся новом окне нажмите « Регрессия », а затем нажмите « ОК ».

В появившемся новом окне заполните следующую информацию:

Как только вы нажмете OK , появится вывод регрессии:

Мы можем использовать коэффициенты из таблицы регрессии для построения оценочного уравнения регрессии:

ŷ = 13,367 + 1,693 (х)

И мы видим, что стандартная ошибка оценки для этой регрессионной модели оказывается равной 6,006.Проще говоря, это говорит нам о том, что средняя точка данных отклоняется от линии регрессии на 6,006 единицы.

Мы можем использовать оценочное уравнение регрессии и стандартную ошибку оценки, чтобы построить 95% доверительный интервал для прогнозируемого значения определенной точки данных.

Например, предположим, что x равно 10. Используя оценочное уравнение регрессии, мы можем предсказать, что y будет равно:

ŷ = 13,367 + 1,693 * (10) = 30,297

И мы можем получить 95% доверительный интервал для этой оценки, используя следующую формулу:

- 95% ДИ = [ŷ – 1,96*σ расч ., ŷ + 1,96*σ расч .]

Для нашего примера доверительный интервал 95% будет рассчитываться как:

- 95% ДИ = [ŷ – 1,96*σ расч ., ŷ + 1,96*σ расч .]

- 95% ДИ = [30,297 – 1,96*6,006, 30,297 + 1,96*6,006]

- 95% ДИ = [18,525, 42,069]

Дополнительные ресурсы

Как выполнить простую линейную регрессию в Excel

Как выполнить множественную линейную регрессию в Excel

Как создать остаточный график в Excel

Загрузить PDF

Загрузить PDF

Стандартная ошибка оценки служит для того, чтобы выяснить, как линия регрессии соответствует набору данных. Если у вас есть набор данных, полученных в результате измерения, эксперимента, опроса или из другого источника, создайте линию регрессии, чтобы оценить дополнительные данные. Стандартная ошибка оценки характеризует, насколько верна линия регрессии.

-

1

Создайте таблицу с данными. Таблица должна состоять из пяти столбцов, и призвана облегчить вашу работу с данными. Чтобы вычислить стандартную ошибку оценки, понадобятся пять величин. Поэтому разделите таблицу на пять столбцов. Обозначьте эти столбцы так:[1]

-

2

Введите данные в таблицу. Когда вы проведете эксперимент или опрос, вы получите пары данных — независимую переменную обозначим как

, а зависимую или конечную переменную как

. Введите эти значения в первые два столбца таблицы.

- Не перепутайте данные. Помните, что определенному значению независимой переменной должно соответствовать конкретное значение зависимой переменной.

- Например, рассмотрим следующий набор пар данных:

- (1,2)

- (2,4)

- (3,5)

- (4,4)

- (5,5)

-

3

Вычислите линию регрессии. Сделайте это на основе представленных данных. Эта линия также называется линией наилучшего соответствия или линией наименьших квадратов. Расчет можно сделать вручную, но это довольно утомительно. Поэтому рекомендуем воспользоваться графическим калькулятором или онлайн-сервисом, которые быстро вычислят линию регрессии по вашим данным.[2]

- В этой статье предполагается, что уравнение линии регрессии дано (известно).

- В нашем примере линия регрессии описывается уравнением

.

-

4

Вычислите прогнозируемые значения по линии регрессии. С помощью уравнения линии регрессии можно вычислить прогнозируемые значения «y» для значений «x», которые есть и которых нет в наборе данных.

Реклама

-

1

Вычислите ошибку каждого прогнозируемого значения. В четвертом столбце таблицы запишите ошибку каждого прогнозируемого значения. В частности, вычтите прогнозируемое значение (

) из фактического (наблюдаемого) значения (

).[3]

- В нашем примере вычисления будут выглядеть так:

-

2

Вычислите квадраты ошибок. Возведите в квадрат каждое значение четвертого столбца, а результаты запишите в последнем (пятом) столбце таблицы.

- В нашем примере вычисления будут выглядеть так:

-

3

Найдите сумму квадратов ошибок. Она пригодится для вычисления стандартного отклонения, дисперсии и других величин. Чтобы найти сумму квадратов ошибок, сложите все значения пятого столбца. [4]

- В нашем примере вычисления будут выглядеть так:

- В нашем примере вычисления будут выглядеть так:

-

4

Завершите расчеты. Стандартная ошибка оценки — это квадратный корень из среднего значения суммы квадратов ошибок. Обычно ошибка оценки обозначается греческой буквой

. Поэтому сначала разделите сумму квадратов ошибок на число пар данных. А потом из полученного значения извлеките квадратный корень.[5]

- Если рассматриваемые данные представляют всю совокупность, среднее значение находится так: сумму нужно разделить на N (количество пар данных). Если же рассматриваемые данные представляют некоторую выборку, вместо N подставьте N-2.

- В нашем примере, скорее всего, имеет место выборка, потому что мы рассматриваем всего 5 пар данных. Поэтому стандартную ошибку оценки вычислите следующим образом:

-

5

Интерпретируйте полученный результат. Стандартная ошибка оценки — это статистический показатель, которые оценивает, насколько близко измеренные данные лежат к линии регрессии. Ошибка оценка «0» означает, что каждая точка лежит непосредственно на линии. Чем выше ошибка оценки, тем дальше от линии регрессии лежат точки.[6]

- В нашем примере выборка достаточно маленькая, поэтому стандартная оценка ошибки 0,894 является довольно низкой и характеризует близко расположенные данные.

Реклама

Об этой статье

Эту страницу просматривали 4986 раз.